(catholicnewsagency.com).-Mientras la humanidad sigue debatiendo sus usos, méritos, peligros, oportunidades y ética, el desarrollo y el uso de la inteligencia artificial (IA) continúa a buen ritmo, lo que dificulta que cualquiera pueda adivinar cómo podría dar forma al mundo en 2025. Ya se dice que algunos de los sistemas de IA más grandes, incluidos los creados por OpenAI, están cerca de lograr la inteligencia artificial general, o AGI: esencialmente, son casi tan inteligentes como los humanos, y sus creadores están lejos de terminar.

La Iglesia católica no ha sido un observador pasivo de la revolución de la IA; Está dando forma activamente a su desarrollo. Al combinar la tecnología de vanguardia con la sabiduría de la Iglesia, los católicos están trabajando para tratar de garantizar que la IA sirva a la humanidad y promueva el bien común. En particular, el propio Papa Francisco ha hablado con frecuencia sobre la importancia de desarrollar y utilizar la IA de manera ética.

Entonces, ¿cómo podrían los católicos usar y dar forma a la IA en el próximo año, y podemos predecir hacia dónde podría ir la «IA católica» a continuación?

CNA habló con varios de los principales expertos católicos en inteligencia artificial para ver hacia dónde podría dirigirse la tecnología en 2025: el padre Michael Baggot, LC, profesor de bioética en el Ateneo Pontificio Regina Apostolorum en Roma; el padre Philip Larrey, profesor de filosofía en el Boston College que anteriormente se desempeñó como decano del departamento de filosofía de la Pontificia Universidad Lateranense en Roma; y Matthew Harvey Sanders, empresario y fundador de Longbeard, una empresa que está desarrollando varias herramientas de IA de alto perfil para aplicaciones católicas.

¿El fin del mundo tal y como lo conocemos?

Es el elefante en la habitación, por lo que es mejor que lo abordemos primero: ¿Tomará la IA un giro siniestro (inserte aquí la trama de una película de ciencia ficción de pesadilla) y nos destruirá a todos en 2025?

La pregunta puede sonar simplista, pero no es un escenario tan descabellado como se puede pensar, al menos según el científico informático Geoffrey Hinton, a menudo descrito como el «padrino» de la IA, quien recientemente provocó titulares frenéticos en todo el mundo cuando opinó que hay una probabilidad de «10% a 20%» de que la IA conduzca a la extinción humana en los próximos 30 años.

Por su parte, Larrey dijo que ha pensado mucho en esta posibilidad de extinción humana de la IA y dijo que se inclina a tomar en serio la evaluación de Hinton. Y, de hecho, Larrey firmó una carta abierta en 2023, uniéndose a varios expertos y pioneros en IA para pedir una moratoria de seis meses en el desarrollo de sistemas de IA más potentes que los ya lanzados en ese momento.

El padre Philip Larrey, profesor de filosofía en el Boston College que anteriormente se desempeñó como decano del departamento de filosofía en la Pontificia Universidad Lateranense en Roma, durante una aparición en el programa «Vaticano» de EWTN. Crédito: Vaticano/EWTN

¿Cómo pudo producirse esta extinción? Bueno, dijo Larrey, ¿qué pasa si una IA con intenciones maliciosas se apodera de códigos nucleares? ¿O decide que quiere engañar a los humanos desprevenidos para que sinteticen y liberen un virus mortal? O, incluso sin intención maliciosa, ¿qué pasa si una IA pone en marcha un escenario apocalíptico por accidente, o como resultado de un hackeo por parte de malos actores humanos?

Para Larrey, que ha hablado y pensado mucho sobre cómo garantizar que la IA esté imbuida de ética, dijo que una frase pronunciada por Elon Musk hace años le parece cierta: «Tenemos que asegurarnos de que las IA nos consideren una parte interesante del universo».

Y se espera que una forma efectiva de hacerlo, dijo Larrey, es que los seres humanos se traten unos a otros con mayor respeto y reverencia para que la IA pueda observar ese comportamiento y aprender de él.

El comportamiento humano es uno de los argumentos más fuertes que la IA puede presentar al considerar cómo debería tratar a los humanos, continuó, y si los humanos no se tratan entre sí con respeto y dignidad, es posible que las IA no los consideren merecedores de una consideración especial.

Además, Larrey dijo que cree que en ausencia de una moratoria sobre el desarrollo de la IA, lo que parece poco probable que suceda en este momento, los católicos deben continuar promoviendo el diálogo entre los especialistas en ética y los desarrolladores de IA. Larrey dijo que ha hablado frecuentemente con Sam Altman, CEO de OpenAI y líder en el espacio, para alentarlo a priorizar el florecimiento humano en el desarrollo futuro de la IA de su empresa.

«En este momento, no tenemos un código de ética universal ni nada sobre la IA. Creo que la Iglesia Católica puede proporcionar orientación hasta que la consigamos. Creo que eso es lo que estamos tratando de hacer ahora», dijo Larrey.

«Si nos equivocamos, será demasiado tarde para corregirlo. El daño ya estará hecho».

Conocimiento y enseñanzas católicas para todos

Entonces, ¿qué pasa con algunas de las oportunidades positivas que la IA presenta para la Iglesia?

Una aplicación de la IA que ha crecido a pasos agigantados, y que seguramente dará aún más saltos en 2025, es la capacidad de la IA para aprovechar y distribuir las enseñanzas y el conocimiento católicos de formas antes inimaginables.

El mundo ya ha sido agraciado con herramientas como CatéGPT, un chatbot diseñado para proporcionar respuestas precisas y completas a preguntas sobre la enseñanza católica basándose en documentos autorizados. Los usuarios también han tenido éxito con herramientas seculares de IA como NotebookLM de Google, que tiene la capacidad de generar podcasts que suenan realistas después de que los usuarios los alimenten con material de origen y se puede usar para destilar y explicar documentos católicos extensos, como el documento final del Sínodo sobre la Sinodalidad.

Pero Longbeard, la compañía encabezada por Sanders, está preparada para hacer un avance aún mayor en este espacio en 2025. Ya ofrece Magisterium AI, un producto de IA generativa centrado en hacer que la enseñanza de la Iglesia y el conocimiento católico sean más accesibles, garantizando que las respuestas generadas se basen en fuentes católicas. Y Vulgate AI, una poderosa plataforma de bibliotecas y otro producto de Longbeard, ya está permitiendo la digitalización y la preservación de las existencias de las bibliotecas en las universidades católicas, lo que hace que estos recursos sean útiles y accesibles para una audiencia global.

Pero Sanders le dijo a CNA que su compañía tiene la mira puesta aún más para 2025.

Matthew Harvey Sanders, empresario y fundador de Longbeard, una compañía que está desarrollando varias herramientas de IA de alto perfil para aplicaciones católicas, durante una aparición en el programa «Vaticano» de EWTN. Crédito: Vaticano/EWTN

El equipo de Sanders está desarrollando Ephrem, el primer modelo de lenguaje católico del mundo, que será entrenado en todo el corpus de «conocimiento católico», una tarea más fácil de decir que de hacer, ya que una buena parte del conocimiento católico del mundo está en forma de libro y almacenado de manera segura en bibliotecas o en el Vaticano.

Sanders le dijo a CNA que para marzo, la compañía espera tener un sistema robótico de última generación en funcionamiento en Roma llamado Alexandria Digitization Hub, que se dedicará a escanear miles de libros y textos católicos antiguos, muchos de los cuales nunca antes se han traducido, y mucho menos digitalizados.

Una vez que tenga copias digitales de cada pieza de «conocimiento católico» jamás producida, completará el «entrenamiento» de Ephrem en ella y la usará para impulsar las herramientas de IA de Longbeard.

La ventaja aquí, dijo Sanders, es que la IA tendrá una base verdaderamente católica para su funcionamiento en lugar de depender de fundaciones seculares de IA como ChatGPT, que se entrenan con diversos conjuntos de datos con valores potencialmente conflictivos y, por lo tanto, han ingerido mucha información no católica, lo que significa que a veces muestran respuestas dudosas cuando se trata de temas católicos.

Longbeard pondrá Ephrem a disposición de los católicos para que lo usen, para crear aplicaciones, productos y otras herramientas, a través de su API (interfaz de programación de aplicaciones), dijo Sanders, lo que significa que grandes cantidades de documentos y libros de enseñanza católica (80,000 hasta ahora, con muchos más por venir) serán accesibles para cualquier persona con una conexión a Internet y estarán disponibles para que los católicos los usen de nuevas formas creativas.

«Cualquier tipo de ministerio u organización católica que busque aprovechar la IA, pero que quiera asegurarse de que la IA sea fiel, podrá construir sobre nosotros», explicó.

Agentes de IA: Asistiendo a sacerdotes, educadores católicos y más

Una aplicación muy publicitada para la IA en el mundo secular es la llegada de los agentes de IA, aplicaciones a las que los usuarios pueden recurrir para realizar tareas como pedir comida, reservar viajes y más.

Sanders dijo que la compañía espera que en el nuevo año, los católicos puedan usar las plataformas de Magisterio y Vulgata para crear agentes de IA útiles que puedan realizar tareas para servir a la Iglesia.

Una aplicación de oración podría crear un agente de IA que los usuarios podrían usar para buscar información sobre un santo mencionado en una sesión de oración, por ejemplo. O bien, un maestro podría usarlo para crear una lección personalizada o un plan de tutoría para un estudiante, convirtiendo al agente en un «socio activo en el proceso de hacer teología».

«Lo que estamos tratando de hacer es proporcionar a los católicos, como maestros y sacerdotes, acceso a herramientas impulsadas por IA, básicamente para ayudarlos a acelerar el trabajo que están haciendo, ya sea preparando una homilía o preparando una lección para los estudiantes, etc.», dijo Sanders.

Por supuesto, no hay mucho que un no humano pueda hacer cuando se trata de ayudar a los católicos, especialmente al clero: naturalmente, las IA nunca podrán escuchar confesiones, por ejemplo, o celebrar misa o cualquier otro sacramento católico.

Pero las personas optimistas sobre la IA tienen diferentes ideas sobre cuán involucradas pueden o deben estar las IA en la vida sacramental de la Iglesia. En particular, una exposición de arte impulsada por IA en Suiza causó un gran revuelo en noviembre cuando numerosos informes de noticias pregonaron que un nuevo «Jesús» con inteligencia artificial había comenzado a tomar las confesiones de las personas.

A pesar de estar colocada en el confesionario, más tarde quedó claro que la instalación de IA estaba destinada a conversaciones, no a confesiones (que solo pueden ser realizadas por un sacerdote u obispo, y nunca en un entorno virtual). Un teólogo de la parroquia suiza comentó, sin embargo, que cree que la IA puede ayudar con el lado «pastoral» de la vida católica.

Por su parte, Sanders dijo que el trabajo de su compañía se trata de «mejorar las capacidades humanas humanas» para ayudar a la Iglesia, incluidos los sacerdotes, y no pretende reemplazar a nadie.

«Aquellos de nosotros que entendemos la naturaleza sacramental de la Iglesia sabemos que es en gran medida una experiencia encarnada. Necesitas estar físicamente allí. Por lo tanto, no hay ningún ámbito de posibilidad en el que una IA pueda formar parte de la economía sacramental. Simplemente no va a suceder».

Las IA también son (no) personas

To go along with the caveat of not letting AIs too far into the Catholic sacramental setting, another point that all three experts emphasized was the importance of not anthropomorphizing AI — in other words, treating it like the tool it is and not as a replacement for true human interaction.

Lamentablemente, numerosos informes de personas que se aferran demasiado a las IA humanas acapararon los titulares en 2024, el más infame de los cuales fue la historia de un niño de 14 años de Florida que desarrolló un apego poco saludable a su «novia» de chatbot y luego se suicidó.

Baggot enfatizó que las IA, si bien son «herramientas tremendas que se pueden poner al servicio de la dignidad humana y el florecimiento humano», hay motivos de preocupación sobre la propagación de «compañeros de IA cada vez más parecidos a los humanos» a los que las personas solitarias recurren cada vez más.

«La IA y otras tecnologías también deben ser una ayuda y un apoyo para nuestras relaciones más importantes con Dios y con el prójimo. Tales tecnologías nunca deberían tratar de reemplazar o restar valor a estas relaciones clave para el florecimiento humano», dijo Baggot a CNA.

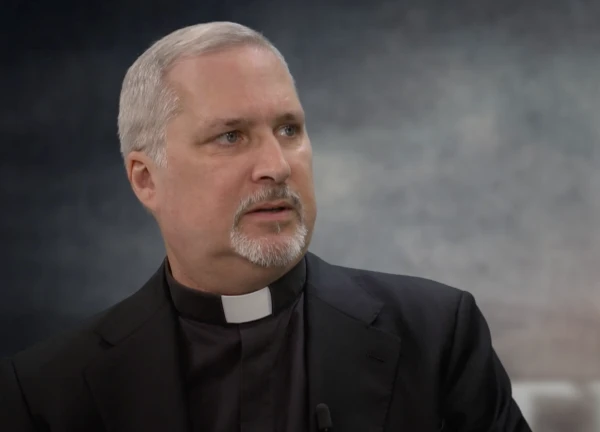

El Padre Michael Baggot, LC, profesor de bioética en el Ateneo Pontificio Regina Apostolorum en Roma, durante una aparición en «EWTN News in Depth». Crédito: EWTN

«Desafortunadamente, varios compañeros de chatbot que afirman ser amigos o incluso amantes a menudo difuminan esta importante distinción. Pueden hacerse con la buena intención de aliviar la soledad, pero a menudo distraen del auténtico contacto interpersonal. También pueden explotar las vulnerabilidades humanas y manipular a los humanos de maneras poco saludables».

Si bien es natural cierto reconocimiento de las cualidades humanas en las máquinas, Baggot señaló que es vital recordar que, a diferencia de las máquinas, los humanos no solo tienen libre albedrío, sino también una capacidad única para comprender el significado y el pensamiento abstracto.

«Perdemos preciosas oportunidades de encontrar el amor de Dios a través de un encuentro humano empático cuando tenemos falsas expectativas de nuestras herramientas de IA», dijo Baggot.

«Los sistemas de IA no pueden entender y compartir nuestras emociones porque no son invenciones humanas sensibles. A veces pueden parecer humanos e imitar las emociones humanas, pero carecen de una vida consciente interior. Los sistemas de IA pueden proporcionar información útil sobre pecados y virtudes, pero no saben lo que es luchar contra la tentación y encontrar la liberación a través de la gracia».

Larrey se hizo eco de Baggot al decir que es importante recordar y enfatizar que los sistemas de IA, a pesar de sus impresionantes capacidades, no entienden el significado y simplemente manipulan símbolos. Se pueden usar para realizar ciertas tareas con gran efecto, pero hay que tener cuidado de no pensar en ellas como verdaderamente humanas: las IA no son capaces de un pensamiento original, sino que operan reconociendo patrones en sus datos de entrenamiento y aplicándolos a nuevos escenarios. Además, reiteró que, si bien una IA puede imitar emociones, en realidad no las experimenta.

ChatGPT, por ejemplo, «simula la comprensión, y está mejorando cada vez más en esto, pero eso no significa lo mismo que la comprensión», dijo Larrey.

Energía nuclear, avances médicos

El entrenamiento y el uso de la IA requieren significativamente más potencia computacional -y por lo tanto más electricidad- que la computación convencional, un problema que ya está molestando a quienes se preocupan por los posibles impactos ambientales.

La reactivación de las centrales nucleares específicamente para impulsar la IA fue noticia en 2024, ya que empresas como Microsoft y Amazon tomaron medidas para poner en funcionamiento las plantas nucleares para alimentar sus últimos proyectos de IA que consumen mucha energía, y se esperan más proyectos nucleares de este tipo en 2025 y más allá.

Por su parte, Sanders dijo que debido a que el desarrollo de la IA tiene la posibilidad de resolver muchos problemas sociales, cree que el desarrollo de la IA debe continuar y, por lo tanto, se requiere una gran fuente de energía. La energía nuclear para la IA es probablemente una buena solución, dijo, ya que es «la forma más segura de lograr la abundancia de energía a escala».

Otra aplicación interesante de la IA que es relevante para la Iglesia es en el campo de la salud. Baggot dijo que ve un potencial significativo para que la IA mejore la atención médica, particularmente para hacerla más predictiva, preventiva y personalizada: por ejemplo, los sistemas de IA pueden analizar imágenes médicas como radiografías, resonancias magnéticas y ultrasonidos de manera más rápida y precisa, y los sensores impulsados por IA podrían detectar problemas médicos o indicadores de salud mental preocupantes en los usuarios.

Sin embargo, enfatizó que la IA debe ser una herramienta utilizada para mejorar el elemento humano de la atención médica, no para reemplazarlo; Habló de la importancia de la relación médico-paciente y de la necesidad de empatía humana, que la IA no puede proporcionar.

«Estas interacciones digitales siempre deben dirigir al usuario hacia encuentros interpersonales», dijo Baggot.